大数据技术已成为当今数字时代的核心驱动力,涵盖数据采集、存储、处理、分析和应用的全链条。掌握这些技术,意味着能够从海量数据中提取价值,驱动业务决策和创新。以下是一份系统的大数据技术盘点,学会其中一半,你便能在数据领域脱颖而出。

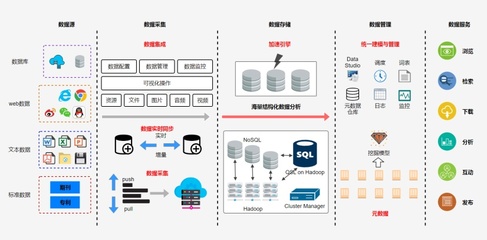

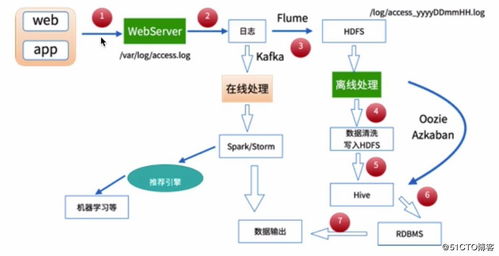

一、数据采集与集成技术

数据采集是大数据处理的起点,关键在于高效、稳定地获取多源异构数据。

- 日志采集:常用工具有Flume、Logstash,用于实时收集日志数据并传输到存储系统。

- 网络爬虫:如Scrapy、Nutch,适用于从网页抓取结构化或非结构化数据。

- 消息队列:Kafka作为分布式流平台,支持高吞吐量的实时数据管道和流处理。

- 数据同步:Sqoop用于在Hadoop和关系数据库之间转移数据,而DataX则支持多数据源同步。

二、数据存储与管理技术

大数据存储需要处理海量数据,并保证可扩展性和可靠性。

- 分布式文件系统:HDFS是Hadoop生态的基石,提供高容错性的存储。

- NoSQL数据库:包括HBase(列存储)、MongoDB(文档型)、Cassandra(宽列存储),适用于非结构化或半结构化数据。

- 数据仓库:如Hive(基于Hadoop的SQL查询工具)、ClickHouse(实时分析型数据库),支持复杂查询和分析。

- 云存储服务:AWS S3、阿里云OSS等,提供弹性、可扩展的存储解决方案。

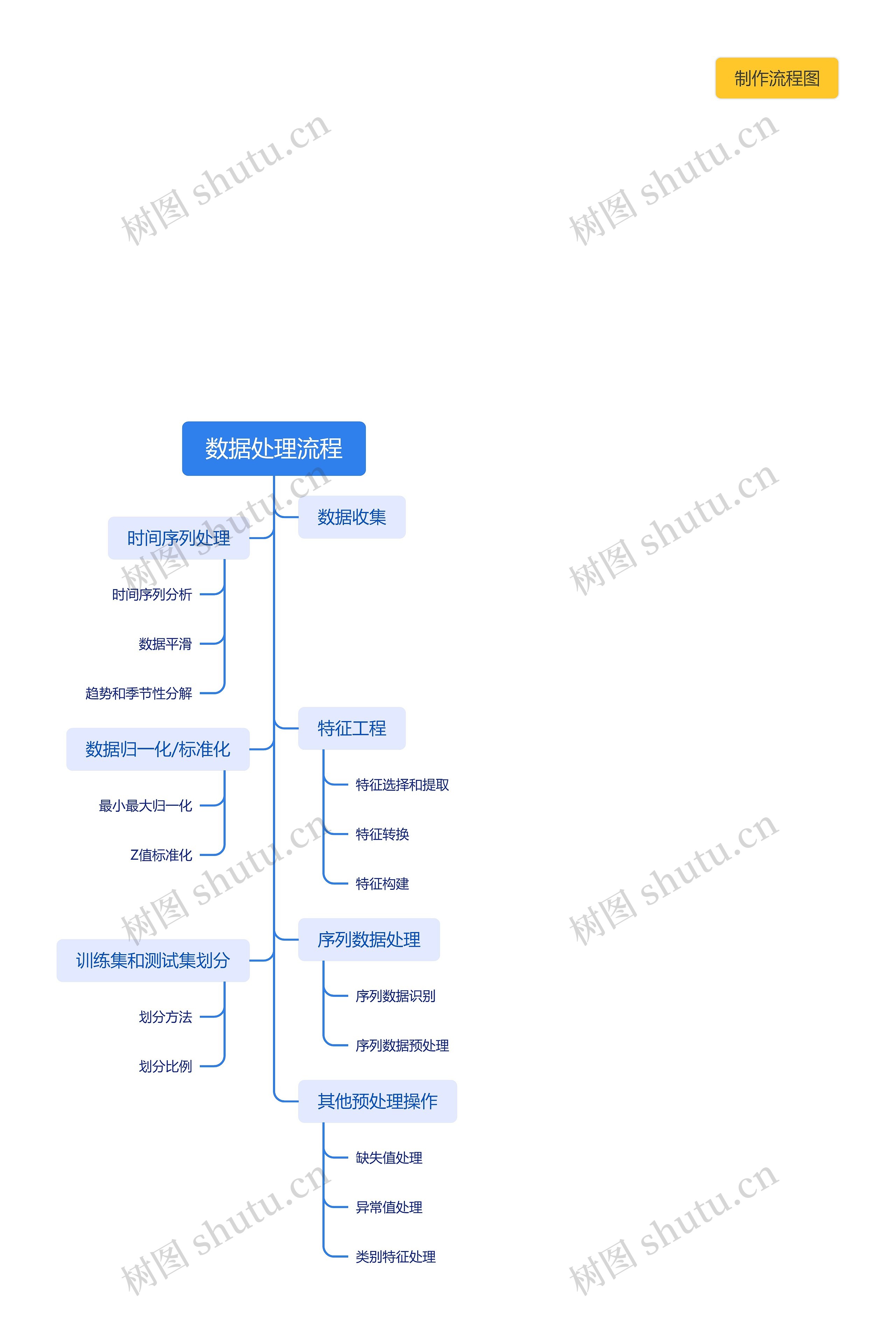

三、数据处理与计算技术

数据处理涉及批处理和流处理,以提取有用信息。

- 批处理框架:MapReduce是经典模型,而Spark凭借内存计算优势,成为更高效的替代品,支持SQL、流处理和机器学习。

- 流处理引擎:Flink和Spark Streaming支持低延迟的实时数据处理,适用于监控、推荐等场景。

- 查询引擎:Presto、Impala提供交互式查询能力,加速数据分析。

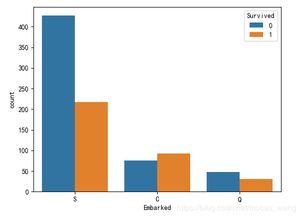

四、数据分析与挖掘技术

数据分析将数据转化为洞察,驱动业务增长。

- 数据挖掘工具:如Weka、RapidMiner,提供机器学习算法进行模式发现。

- 机器学习框架:TensorFlow、PyTorch用于构建深度学习模型,而Scikit-learn则适合传统机器学习任务。

- 可视化工具:Tableau、Power BI帮助将复杂数据转化为直观图表,便于决策。

- 统计与分析平台:R语言和Python(Pandas、NumPy库)是数据科学家的必备工具。

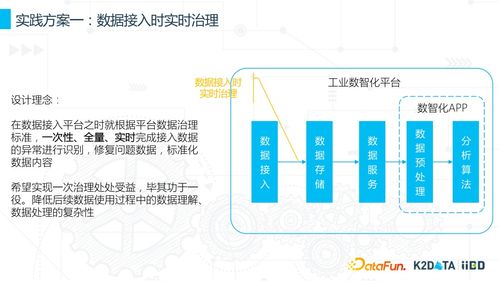

五、数据治理与安全技术

随着数据规模扩大,治理和安全至关重要。

- 元数据管理:Atlas、DataHub帮助追踪数据血缘和分类。

- 数据质量:Great Expectations、Deequ确保数据准确性和一致性。

- 安全与隐私:Kerberos用于认证,Ranger和Sentry提供细粒度访问控制,而差分隐私技术保护用户数据。

六、云原生与新兴技术

云计算和新技术正重塑大数据领域。

- 云原生平台:AWS EMR、Google Dataproc提供托管的大数据服务,简化运维。

- 实时数仓:如Snowflake、阿里云AnalyticDB,结合了存储和计算的弹性。

- 数据湖架构:Delta Lake、Iceberg支持ACID事务,提升数据湖的可靠性。

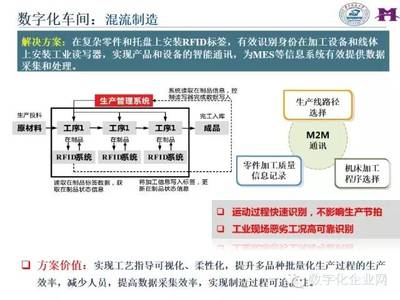

- 边缘计算:适用于物联网场景,在数据源头进行初步处理。

大数据技术生态丰富多样,从基础采集到高级分析,每个环节都不可或缺。对于学习者,建议从Hadoop和Spark入手,逐步扩展到流处理和机器学习。掌握一半以上技术,不仅能处理复杂数据问题,还能成为企业中的数据大牛,引领数字化转型。持续学习新技术,如云原生和AI集成,将帮助你在快速发展的数据领域保持竞争力。